LumiのツールボックスにあるAI機能を使用すると、大規模言語モデル(LLM)を自分のプロジェクトにシームレスに組み込むことができます。自然言語のプロンプトを通じて、複雑な設定手順なしでAI機能を簡単に有効化および設定でき、モデルの統合をより速く、よりスマートに、より直感的にします。Documentation Index

Fetch the complete documentation index at: https://docs.lumi.new/llms.txt

Use this file to discover all available pages before exploring further.

サポートされているAIモデル

Lumiは現在、Google GeminiおよびOpenAI GPTファミリーの複数のモデルをサポートしています。各モデルには、さまざまなユースケースに合わせて異なるパフォーマンスと価格帯があります。| モデル | ティア | 推奨される使用方法 |

|---|---|---|

| Gemini 2.5 Flash | 中間層(デフォルト) | バランスの取れた推論と効率のための汎用アシスタント |

| Gemini 2.5 Pro | 高度層 | 高度な推論と複雑な分析 |

| Gemini 2.5 Flash Lite | エントリー層 | テキスト分類などの大規模で低レイテンシのタスク |

| Gemini 2.5 Flash Image(Nano Banana) | 中間層 (ビジュアル) | 画像生成とクリエイティブなデザインタスク |

| Gemini 3 Pro Image(Nano Banana Pro) | 上位層 (ビジュアル) | 高度な精度と制御で画像を作成および編集 |

| GPT-5 | 高度層 | 複雑な推論と意思決定アプリケーション |

| GPT-5 Mini | 中間層 | 中程度の複雑さのワークフローと自動化タスク |

| GPT-5 Nano | エントリー層 | 大量の軽量タスク |

| GPT-4o | 高度層 | 高度なマルチモーダル理解と高品質のテキスト生成 |

AIモデルを有効にする

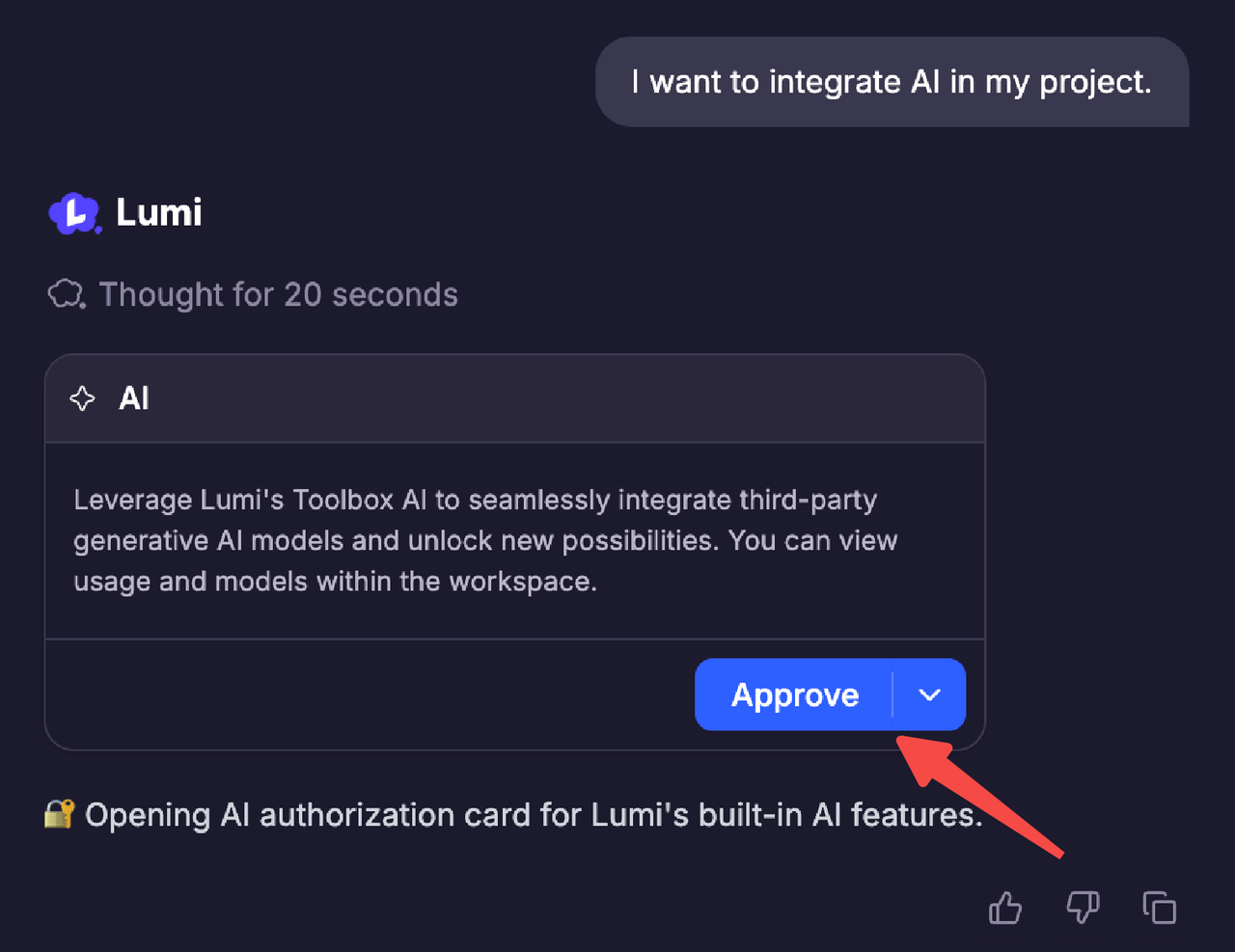

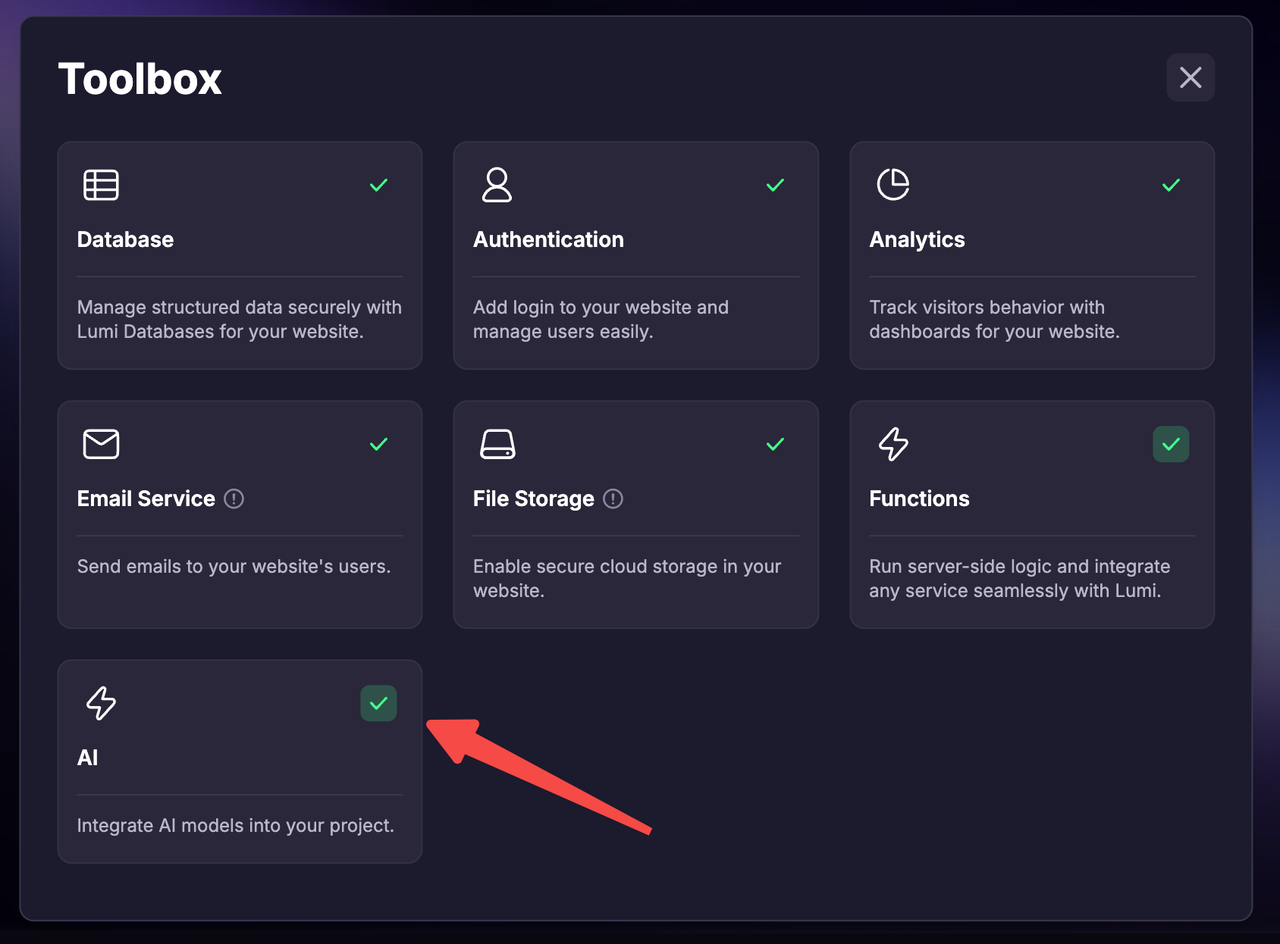

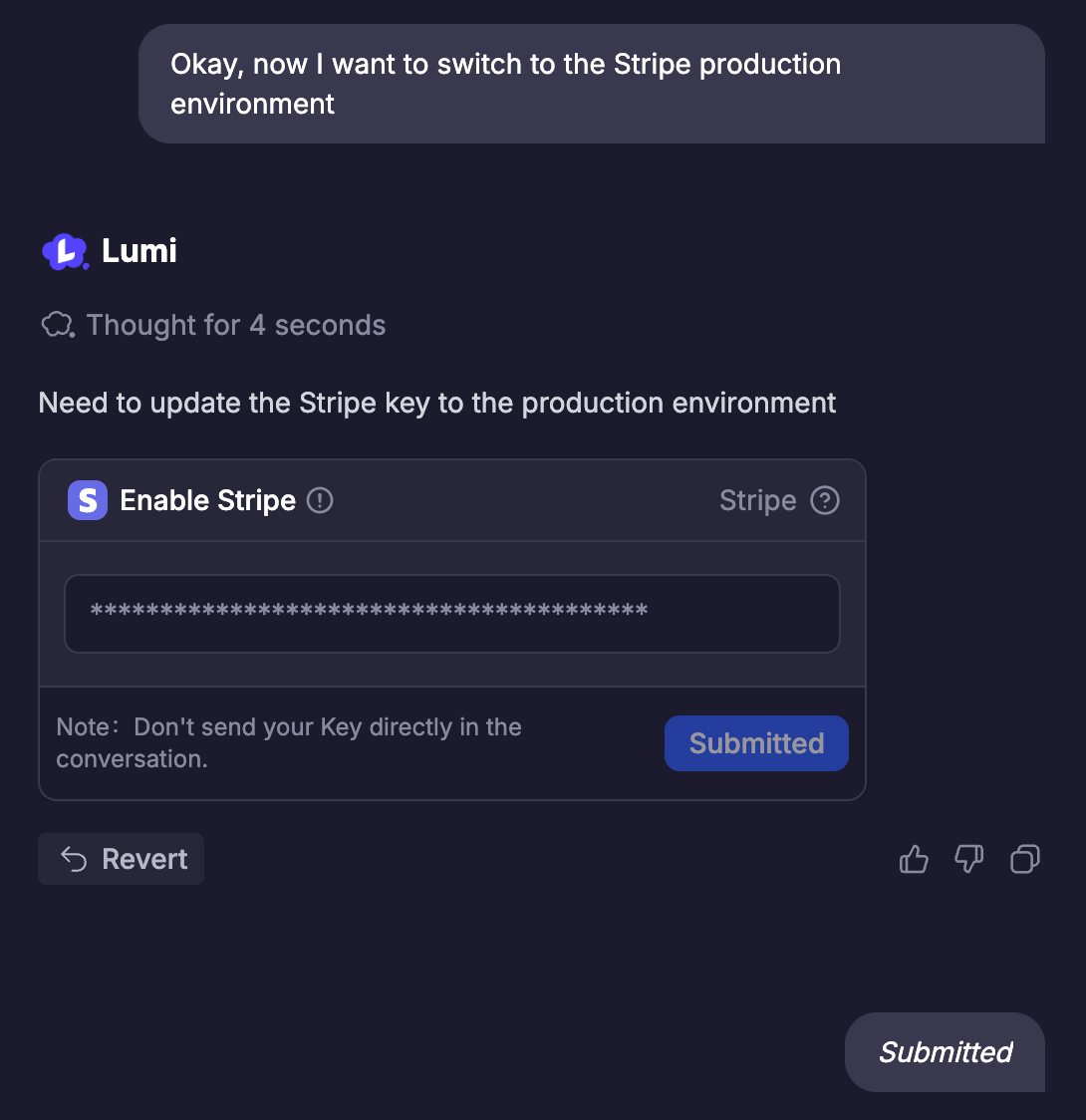

デフォルトでは、AI機能は無効になっています。次の3つの方法のいずれかで有効にできます。-

会話を通じて — AI機能の統合または使用を依頼すると、LumiはAIを有効にするように促します。

-

ホームページのツールボックスから

-

ワークスペースから

AIモデルの管理

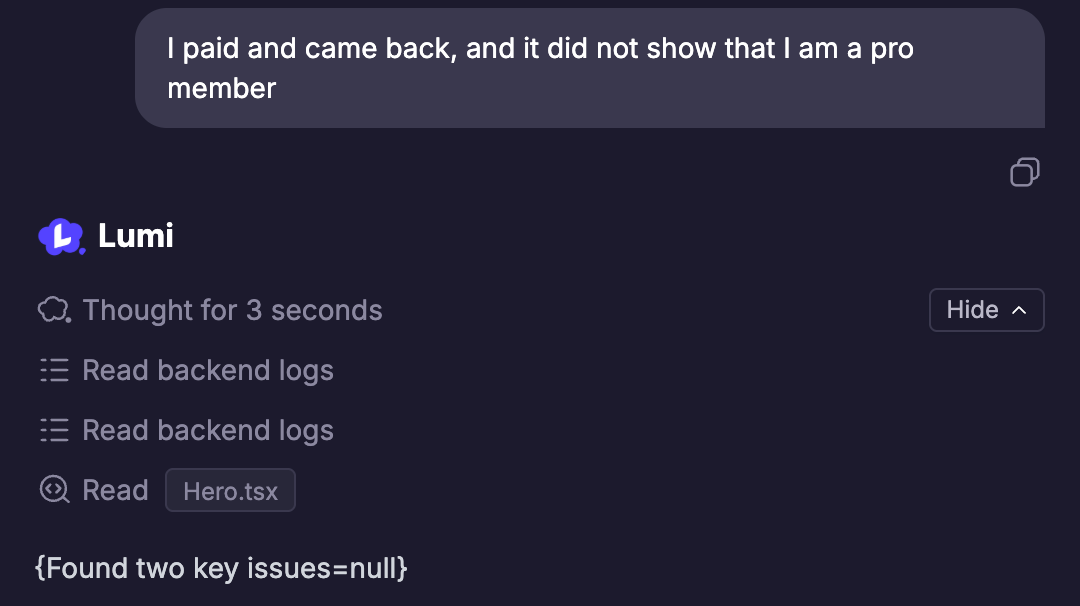

ワークスペースで専用のAIパネルが利用可能になり、AIの使用状況を完全に可視化できます。

- 時間範囲によるフィルタリングオプションを使用して、リアルタイムのモデルコールと使用状況を監視します。

- 統合された各モデルの詳細なツールクレジットの消費量を確認します。

サブスクリプションと請求

- サブスクリプション要件はありません — すべてのLumiユーザーがAI統合にアクセスできます。

- AIの使用量はツールクレジットと共に請求されます。

- プロジェクト内のすべてのAI使用量は、作成者のツールクレジット残高に請求され、プロジェクトユーザーは費用を負担しません。